Xcode 11 での SceneKit の変更点 その3 - リフレクションプローブ

リフレクションプローブ(Reflection Probe)とは?

ライトプローブ同様に周囲の光(色)をキューブマップとして焼き込み、周りの反射するマテリアルに適応する。設定方法はライトプローブと変わらない。

ARKit の environmentTexturing プロパティ、AREnvironmentProbeAnchor で生成される環境マップの表面反射と同様。

ただし、ARKit はカメラ画像から推論して周囲の画像を生成しているが、リフレクションプローブはカメラからちゃんと画像を生成する。

プロパティやメソッドは過去記事参照。

リフレクションプローブが反射するため物体を捉えるエリアとそれを使用した反射を適応できる範囲を設定することができ、

そしてリフレクションプローブが生成する環境マップの適応を位置をオフセットとしてずらすことができる。

以下の画像の白い球体の枠が反射する物体の範囲。

赤い立方体は反射の影響を受ける物体の範囲。

背景は白い範囲外でも影響を受け、赤い立方体から外れるとリフレクションプローブの影響を受けなくなる。

また、ライトプローブの様に Manual で開発者側が計算してテクスチャを生成するのだが、リフレクションプローブはリアルタイム (Scene Editor では Live) で周囲の情報を取得することができる。

Scene Editor で Manual に設定した場合、ライトプローブと同様に Compute ボタンを押してテクスチャを生成する必要がある。

注意点

リアルタイムのリフレクションプローブはそれなりに処理が重いので注意。

バグ? 仕様?

リアルタイムのリフレクションプローブでパーティクルが反映されない。

Beta の初期や iOS シミュレータでは反映されるためバグな気がしないでもない。

一応、Feedback にバグリポート済み。

次回はスクリーンスペースリフレクションについて。

Xcode 11 での SceneKit の変更点 その2 - エリアライト

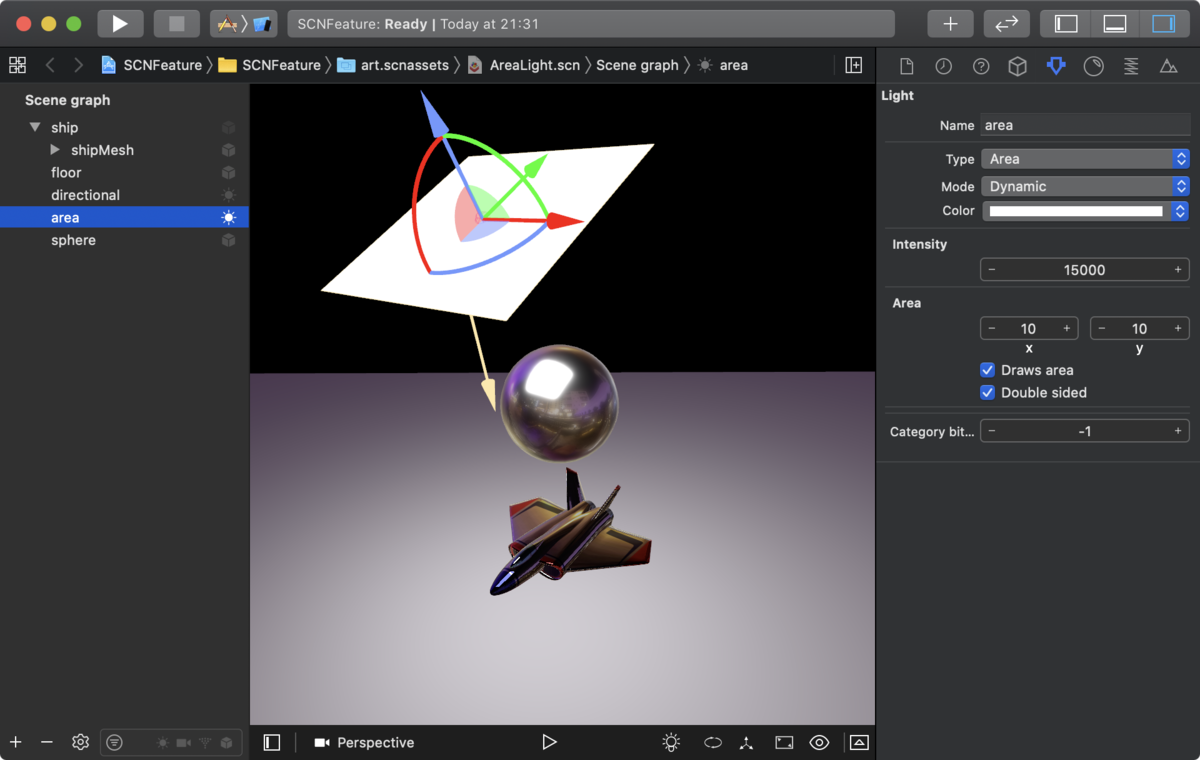

エリアライト (Area Light) が追加された。

ライトタイプを area に変更するだけ。

let light = SCNLight() light.type = .area

プロパティやメソッドなどは過去記事参照。

エリアライト

いわゆる面光源。

diffuse に柔らかに光を当て、面光源の形状のハイライトを付加する。

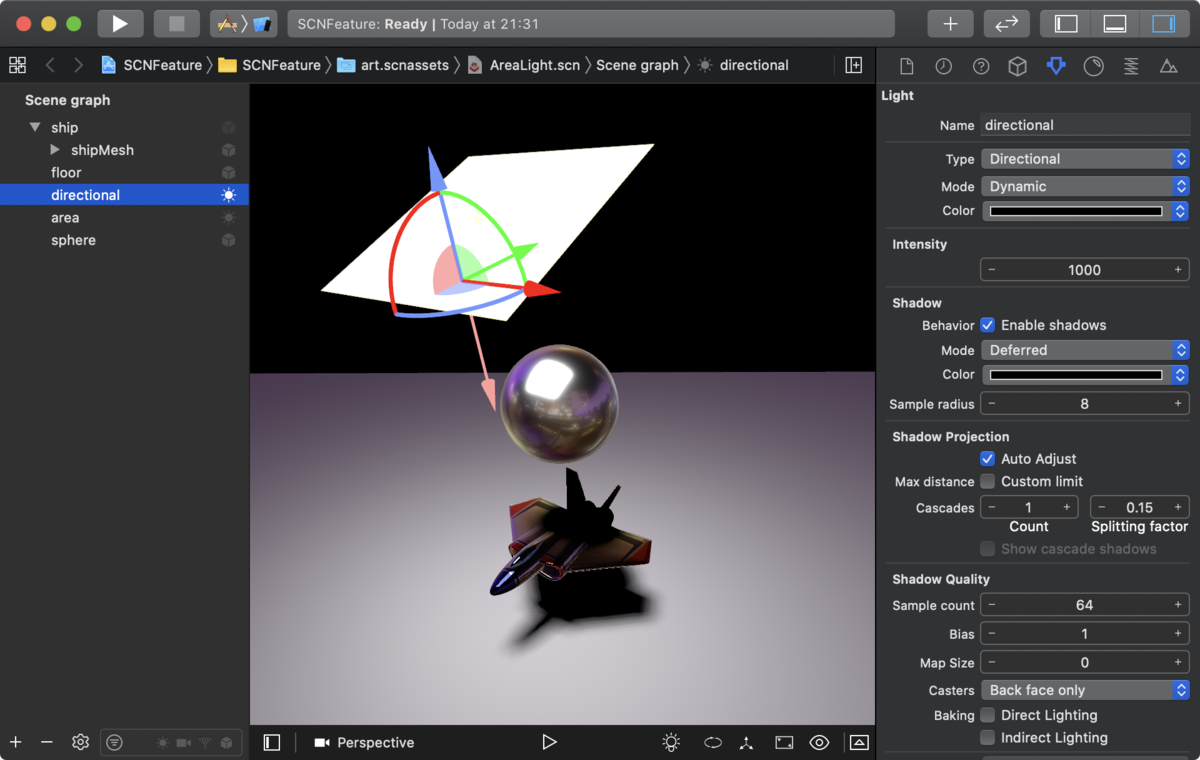

3DCG DCC ツールのオフラインレンダラーの様なエリアシャドウの様な影を落とすことができない。

というか、影が落ちないので、スポットライトかディレクショナルライトを使用して別途 Differed にして影を落とす。

エリアライトはノードのスケール以外に、エリアライト自体で大きさを設定でき、両面の描画したり、ハイライトとして光を落とすが面光源自体を描画しない設定がある。

用意されている設定は矩形しかないが、NSValue で X、Y を設定した配列を使い自由な形状の面光源を設定できる。

let light = SCNLight()

light.type = .area

light.areaPolygonVertices = [

NSValue(cgPoint: CGPoint(x: 0, y: 0)),

NSValue(cgPoint: CGPoint(x: 0.2361, y: 0.7265)),

NSValue(cgPoint: CGPoint(x: 1.0, y: 0.7265)),

NSValue(cgPoint: CGPoint(x: 0.382, y: 1.1756)),

NSValue(cgPoint: CGPoint(x: 0.618, y: 1.9021)),

NSValue(cgPoint: CGPoint(x: 0.0, y: 1.4531)),

NSValue(cgPoint: CGPoint(x: -0.618, y: 1.9021)),

NSValue(cgPoint: CGPoint(x: -0.382, y: 1.1756)),

NSValue(cgPoint: CGPoint(x: -1.0, y: 0.7265)),

NSValue(cgPoint: CGPoint(x: -0.2361, y: 0.7265))

]

エリアライトは 2D 平面のライトを設定するため、3D 形状の光を与えたい場合はライトプローブを使用する。

エリアライトのバグ

エリアライトの描画が欠けることがある。

Feedback へバグリポート済み。

次回はリフレクションプローブについて。

Xcode 11 での SceneKit の変更点 その1 - 概要と Scene Editor

リリース版が出たので詳細を書いていこうと思う。

コードのプロパティやメソッドは過去記事参照。

- Scene Editor の変更

- エリアライトの追加

- リフレクションプローブの追加

- シーン全体のスクリーンスペースリフレクションの追加

- カメラの Bloom のプロパティとホワイトバランスの追加

- マテリアルでクリアコートのプロパティが追加

Scene Editor

プレビュー下に Default lighting が追加

Xcode のアプリメニュー Editor > Rendaring Option > Enable default lighting で設定していたものが、Scene Editor 上でできる様になった。

Default lighting はシーン上にライトがない場合これを設定すると、シーンにアンビエントライトが追加される。

また、Xcode 11 から Default lighting のライトの適応され方が変更された。

(上の画像が OFF / 下の画像が ON)

プレビュー用の機能なので実際ビルドした際はみためが異なる場合があるので注意。

ライブラリ

Library のモーダル (Command + Shift + L) から、ドラッグ&ドロップできる項目で「Area light」「Reflection Probe」が追加された。

Gabo (Directional Light / Spot Light のみ)

Scene Editor 上でライトの Gabo が設定できる様になった。

基本的には過去記事でコード上で書いた状態と同じ。

Gabo については過去記事から抜粋。

ライブや舞台等で、ライトの前に光の当てたい部分を削ったプレートを置いて照明を照らすことで、壁面に絵や文字を投影することができ、そのプレートや効果を指すとのこと。

SCNLight の shadowMode を modulated にしないと適応されないため、Scene Editor 上でも「Modulated」にしないと Disable 状態で画像を設定できない。

また、現状ドロップリストから画像が選択できないため、ドラッグ&ドロップで設定する。

Custom Shader / Shader Modifiers のプロパティ表示の変更

NSTableView の表示だったが、「+」ボタンを押して項目が追加される様になった。

設定できるものは以前と同様に、Float, Float4, Color, Texture となっている。

バグ: Scene Editor の左側 Scene Graph View

Library のモーダル (Command + Shift + L) から、ドラッグ&ドロップで Scene Graph View ドラッグした際にドロップできない場合がある。

ちなみに Xcode のバグで SpriteKit でも同様に起きる。

Feedback にバグリポートを出したがリアクションなし。

次回、エリアライトについて

SIM フリーの iPhone XS を売りに行ったら SoftBank さんのネットワーク利用制限が ▲ だった

面白いことがあったので書き留めておく。

今回、端末買取の際の登場人物では誰一人悪くないところがすごい。

結論としては今回の SIM Free iPhone XS に関しては SoftBank さんのネットワーク利用制限を解除できなかった。

(正確にいうと方法がわからなかった)

ちなみに自分は宗教上の理由で SoftBank さんの回線を現在は持っていない。

2019年9月25日

2018年10月28日 Apple 新宿にて iPhone XS 256GB スペースグレイを購入し、iPhone 11 Pro を発売日に購入したため、夕方 iPhone XS を 近所の IOSYS さんに買い取ってもらいに行く。

査定時に事件が発生し、SIM フリーの端末なのに SoftBank さんのネットワーク利用制限が ▲ になっているとのこと。

通常、6万強で買取できるが、ネットワーク利用制限がかかっているので5万円くらい。

買取価格はどうでも良く、どうしてそうなっているの知りたかったので買取をやめ、Apple 新宿に向かう。

Apple 新宿でスタッフさんをひっ捕まえてことを話したら、その様な状況になることないとのこと。

ということで、新宿の Softbank に向かい、端末を調べてもらうと当たり前だが Softbank では契約されていないと判断された。

原因が全くわからないので、じゃんぱらさんで査定していただき状況は同じ状態。

まだ時間的にヨドバシ Akiba の SoftBank ショップが営業していたので来店。

ありがたいことに長い間調べていただいたが、商品の管理としては、自分の XS はソフトバンクのものだが、回線の契約がされていないとのこと。

IMEI で紐づいているネットワーク利用制限に関しては SoftBank さんの回線契約がないと変更できないないとのこと。

ちなみに docomo は可能。

SoftBank ショップの判断としては、Apple さんが商品登録の際に SIM Free の端末ではなく SoftBank 管理商品として登録してしまったのではないかという結論。

うちでは処理できないので Apple さんに問い合わせてくれとのこと。

順番待ちも含め所要時間、約 1.5 時間。

26日から出かける予定があったので、いったんお預け。

2019年9月26日

サポートアプリからこの旨のメールを投げる。

2019年9月27日

返信が来るがこちらでサポートできないので、他に送ってくれという内容。

どこに問い合わせたら良いかわからんので「購買/購入」という項目を選んだが、どうやら iTunes Store とかデジタルストア向けらしい。やられた。

書いたメールの内容を忘れたので、Apple 表参道でのジーニアスでの対応を28日に予約。

静岡まで行っており、そのまま新幹線で博多まで行こうとしたが気になったのでキャンセル。

2019年9月28日

無駄だとはわかっていたが、Apple 表参道で対応していただくが状況変わらず。

以下の診断を受ける。

とりあえず、この現象のエスカレーションを上げてくれていることを願う。

2019年9月29日

こちらも無駄だと思うが、直営店である東京駅の SoftBank に行ってみたが対応できないと言われた。

八方塞がりとなったため、近所の IOSYS さんにまた買い取ってもらいに行く。

(説明ミスったので2回並んだ)

内容を説明すると商品的にはジャンクということになり買取価格は2万となった。

状況を説明すると減額になるのね。驚き。

面倒なのでそのまま売る。

もし初日の状態買い取られていたら、ネットワーク利用制限が変えられないものが結構なお値段で販売されてたわけだし、既に同じ状況のものが買い取られて売られているのかもしれない。

(状況を説明しなければわからんので)

気になっている点

アプリ開発的に IMEI や端末のシリアルは取れないので、購入後変更された可能性は低い。

(プライベート API なら取得可能だがアプリの審査に通らない)

となると、SoftBank ショップで言われた様に原因は購入前にある可能性が高い。

で、これが本当だと気になる点が2つある。

- 最終的に SoftBank の管理在庫の帳尻が合わなくなる可能性

- Apple のスタッフが在庫を入れ替えた可能性

管理在庫の帳尻が合わなくなるのは調整できるとは思うが、やはり1つなくなったことになるので最終的に問題が起きる。

もう1点は Apple のスタッフが、ただのヒューマンエラーか故意はわからないが、商品の入れ替えを行うことができたということになる。

悪意をもって説明すると、自分のケースの逆で SoftBank を契約している人に対して SIM Free の在庫を売ることが可能になる。

もし可能かつ意図的にやっているなら、IMEI なんて普通調べないから、売却するまでわからず悪質である。

回避する方法

Apple Store の裏側から商品が出され、外見ではわからないし、使用していてもわからないので、正直回避しようがない。

なので、返品できる期間内に IMEI 番号を調べてひっかかる様なら返品するしか方法がない。

まとめ

SIM 関連の煩わしさを回避するため付加した支払いをしているのに逆に面倒になる始末。

IIJ から回線を docomo に切り替えようかと思っているのでもうキャリアで買った方が良いかもしれない。

あと、Apple 新宿は怖すぎるので、2度と買い物できない。

P.S.

今回、Apple、SoftBank を巡回する際に、SoftBank の回線契約をしたことがないと言ったが、iPhone 4 までは SoftBank の契約をしていたことを思い出した。

お詫びして訂正。

iPhone 11 Pro のカメラとその感想

iPhone 11 Pro で超広角カメラが追加され、望遠カメラやポートレートモードが強化。

また、カメラだけしか特出する部分がなかった Google Pixel 3 の Night Sight をパクった Night mode が追加された。

強く推したいのは画角が120度となる超広角カメラ追加され、iPhone にアクションカムが追加された様なものであると思っている。

アクションカムが付き、Apple TV+ が1年無料と考えると実質無料な気はする。(無料ではない)

超広角、広角、望遠カメラの比較

東京駅で同じ場所で撮り超広角、広角、望遠のレンズだけ変えたもので、スペック通りの大きさでズームする。

神田明神(超広角は Night mode 適応外)

以降も夜の写真。昼間は以前の iPhone でも綺麗に撮れていたため。

超広角カメラ

ヨドバシ Akiba の外観を撮ってみたが、広角だとギリギリ切れる場所でも超広角なら余裕でフレームに入る。

また、このぐらいの明るさなら Night mode を使用しなくても綺麗に撮れる。

東京駅 丸の内北口 ドームの天井

ただし超広角カメラには以下の制限がある

- Night mode が使用できない

- 光学手振れ補正がない

- 4K 60fps の動画撮影ができない(望遠も同様)

Night mode

長時間露出と端末処理により光の少ない暗い空間を iPhone が明るい写真へ頑張ってくれる機能。

そもそも広角レンズ自体が明るく、実際の見た目は超広角の画に近い。

神田明神にて狛犬を同じ場所で Night mode が使えない超広角と Night mode の広角で撮ったもの。

Night mode では周囲のディテールがほぼ写っている。

軽く動かした感じだと、

撮影時間に関しては明るい夜道は1秒ぐらい。

少し暗いと3秒、手をある程度固定した場合5秒ぐらい限界の模様。

手を何かに置いて固定すると10秒ぐらいまではいけた。

三脚を使用すると最大30秒までのばせるらしいので、場所によっては星がそこそこ綺麗に撮れそうではある。

9秒ぐらい伸ばしてみたが、自分の眼では見られなかった星が撮れた。

その時見えたのは1番輝く星ひとつだけ。

同じ様に9秒で撮影。

対象物がない場合ノイズが多く載る傾向にある

ここら辺は残念ながら Huawei のカメラの方画質が良い。

Night mode を使用した緑色になる傾向にあり、光はあまりなくても空間全体に光が当たる状態が望ましい。

そのため、空間に光があまり当たってない部分は暗いままかノイズが多く載る。

試しにトイレを照明を消し、扉を軽く開けて撮ってもほぼ暗いままだった。

(それでも形がわかるぐらいまでは見える )

また、プレビュー時も Night mode に近い状態になっており、機械学習か、前のフレームからの合成か、超広角との合成か不明だがよくできている。

Night mode では自動で写真撮影の秒数が設定される。星空など微かな光を撮りたい時以外は自動より秒数を増やしてもほぼ変化はない。

望遠

地味に変更がされておりレンズの明るさが変わっている。

超広角の方が価値があるため、機能的にも Pro のみについているのは理解でき、風景を撮影する時、画の密度が変わるため綺麗な画になる感はある。

あと、人やものを撮影する場合など望遠が重要だったりする。

動画

動画撮影に関しては基本変わらないので割愛。

(意訳: Hatena 動画がアップできないので面倒)

とりあえず、超広角に関しては手振れ補正がないためジンバルをお薦めする。

DJI のスマートフォン向けのやつは固定用の三脚がついても2万しないので一家に一台といったところ。

iOS13 の機能だが、動画編集では今までできなかった傾きや切り取りなど、写真同様のことが可能で iMove を使用しなくて変更ができる。

個人的には動画の尺の調整後、新規ファイルを作成せず、そのファイルのまま再生時間が変更される様になったところが良い。

その他、個人的に端末の良いところ

iPhone XS を使用していたのだが、本体の重量バランスや背面ガラス、カメラの出っ張りの問題でいつの間にか机などから落ちるという現象が今回は起こりにくくなっている。

ダメなところ

3D Touch がなくなり、Haptic Touch と名をうった長押しに変更された。

そのため一部面倒な部分が出てきている。

例えば、ヴァーチャルキーボードは長押しが他の動作に割り当てられているため、3D Touch でのぐい押しでカーソル移動がどこでもできなくなった。

スペースキー(空白)でしか使用できないため、テンキー入力時はスペースキーの位置がかなり遠い。

そして、右端にスペースキーが配置されているため現在の位置より右に行きたい場合は、一度左に移動させて右に移動するしか方法がない。

また、Haptic Touch は長押しなのでスクロールする部分で長めに押してしまい誤動作することがある。

iPad では 3D Touch を実現するのは難しいだろうし、Apple 曰くユーザーがあまり使っていないらしいので廃止という流れなのだろう。

まとめ

これまでの iPhone のカメラはポートレートモードで人物やものに焦点を当ててきたが、今回からは背景などアクションカム的な要素も制覇し死角をなくそうとしている感はある。

そして、次期 iPhone で超広角の手振れ補正が追加されればアクションカムを殺しにかかれるだろうし、手軽さだけを考えれば幾度と言われているがコンデジの立場も辛くなっていくだろう。

5G や Apple A チップの機能向上をなど、来年も良い性能アップを期待している。

不具合

2日目にして充電後に動きが緩慢になり何かするとローディング(振る舞い的にホーム/スプリングボードを再起動している)が繰り返された。

Apple 丸の内に当日修理しようとしたが、ストアの前で一応端末を確認したら正常に動作をしていたのでそのまま帰った。

Xcode の Devices のクラッシュログを見るに電源周りで CPU を使いまくっており、原因は不明。

謎の復帰を遂げたので同現象が起きた方や治った方は教えて欲しい。

3G から使っているが電源周りでおかしくなったのはこれが初めてなので。

A13 Bionic のベンチマークとその先

Geekbench からの現状の集計をまとめてみた。

Geekbench 5 から基準値が変わったため以前と値が異なる。

| SoC | GHz | Single | Multi | Metal |

|---|---|---|---|---|

| iPad Pro (3rd 12.9-inch) A12X Bionic |

2.5 | 1112 | 4606 | 9115 |

| iPhone 11 Pro A13 Bionic |

2.7 | 1326 | 3359 | 6355 |

| iPhone XS A12 Bionic |

2.5 | 1108 | 2618 | 4527 |

| iPhone X A11 Bionic |

2.4 | 917 | 2354 | 3229 |

| iPad Pro (2nd 12.9-inch) A10X Fusion |

2.3 | 832 | 2280 | 6394 |

| iPad (6th) A10 Fusion |

2.3 | 757 | 1406 | 2787 |

| iPhone 7 A10 Fusion |

2.3 | 744 | 1323 | 2766 |

| iPad Pro (1st 12.9-inch) A9X |

2.3 | 650 | 1201 | 3626 |

| iPhone 6s Apple A9 |

1.8 | 542 | 990 | 2221 |

以下の伸び率となる

- Single 1.2 倍

- Multi 1.3 倍

- Metal 1.4 倍

2017年末に発売された2世代目の iPad Pro A10X Fusion と同等の Metal 性能で、CPU 性能は余裕で A13 Bionic は超える。

Android 端末との比較

| 端末 | Single | Multi |

|---|---|---|

| A13 Bionic | 1326 | 3359 |

| iPhone XS A12 Bionic |

1108 | 2618 |

| OnePlus 7 Pro Snapdragon 855 |

721 | 2640 |

| Samsung Galaxy Note10 Snapdragon 855 |

706 | 2531 |

| iPhone X Apple A11 Bionic |

917 | 2354 |

| Huawei Mate 20 Pro Kirin 980 |

673 | 2273 |

| Sony Xperia XZ2 Snapdragon 845 |

497 | 2058 |

| Google Pixel 3 XL Snapdragon 845 |

490 | 1984 |

前回の記事同様。

Single で Snapdragon 855 の約2倍、Multi は 1.27倍。

Snapdragon 855 は Big Core × 4、Little Core × 4 の構成で Big Core の中の 1 つはさらに速いものとなっている。

周波数的には 2.84、2.42、1.80 GHz。

以前の Snapdragon は Big と Little をスイッチしていたため、Multi Core の際に全てのコアを動かすことができなかったが、それが可能になり、

855 は 845 比べて約 1.3 倍となった。

だが、高速な Prime Core があっても Single Core は A11 にはおよばず、A12 と比べて Big Core が 2 倍もあるのに Multi Core のベンチマークがほぼ変わらないところに厳しさがあると思われる。

Mac

一応、書いてみた。

7世代目のモバイル版 i7、8世代目のデスクトップ版 i3 と同等。

| SoC | Core | GHz | Single | Multi |

|---|---|---|---|---|

| iMac Pro Xeon W-2191B |

18 | 2.3 | 1111 | 13452 |

| iMac Pro Xeon W-2140B |

8 | 2.3 | 1087 | 8185 |

| MacBook Pro 15-inch 2019 i9-9980HK |

8 | 2.4 | 1114 | 6913 |

| MacBook Pro 13-inch 2019 i7-8569U |

4 | 2.8 | 1072 | 4111 |

| MacBook Pro 15-inch 2017 i7-7700HQ |

4 | 2.8 | 872 | 3424 |

| iMac 21.5-inch 2019 i3-8100 |

4 | 2.8 | 926 | 3372 |

まとめ

かなり、ラップトップの Mac、PC(薄いタイプ)に近づいてきた。

もし、来年チップのプロセスルールが 5nm となるのならかなりの飛躍が期待できる。

また、Apple A13X が出て、A13 同様 20% 上がるのなら第8世代目のデスクトップ版 Core i7 の Multi Core と僅差となり、第9世代目の i5 同等になる。

個人的には現状 Pro ではない MacBook は iPad Pro に置き換えても良いのではないかと思っている。(というかそうして欲しい)

iPadOS 13 でアプリ側の対応が必要だが同じアプリを複数開くことができる Multipule Window の機能が追加されたことによって、Mac に近い操作感をもたらすだろう。

また、macOS で iPadOS ライクなアプリを開発できる Mac Catalyst もその流れなのかもしれない。

今後のスマートフォンの流れを考えると、

Android 10 の Desktop mode の様にスマートデバイスを外部ディスプレイに繋ぎデスクトップライクな操作が流れの様な気はしている。

(一応、iOS/iPadOS では端末と外部出力で異なる表示が初期から可能。Keynote など)

余談

今のスマートフォンは Window Phone の影響が大きいと思っており、フラットデザインやカメラの高機能化、そして Continuum をパックってインスパイアされている様でいて面白い。

A13 Bionic のスペックを予想する

1つ前の記事からそのまま載せたもの。

Apple A チップのプロセスルールが 7nm から 7nm+ 変更されたため、集積率20% アップ、消費電 15% ダウンとなっている。

基本的には 全体で20%上がり、最低でも使用時間が 15% アップする。

Apple Evenet では A12 と比較し、20%高速で40%省電力とのこと。

コア的に、高性能コア Lightning * 2、省電力コア Thunder * 4 と数は変わらないものの A12 の 6.9 billion から 8.5 billion のトランジスタとなっている。

以下、Geekbench から見た予想値。

(Geekbench の基準値が変更されたため今までと値が異なる)

| SoC | Single | Multi | Metal |

|---|---|---|---|

| iPad Pro (3rd 12.9-inch) A12X Bionic |

1112 | 4602 | 9134 |

| A13 Bionic ? | 1328 | 3217 | 5323 |

| iPhone XS A12 Bionic |

1107 | 2681 | 4436 |

| iPhone X A11 Bionic |

917 | 2351 | 3231 |

| iPad Pro (2nd 12.9-inch) A10X Fusion |

834 | 2280 | 6409 |

| iPad Pro (1st 12.9-inch) A9X |

651 | 1202 | 3625 |

| iPad (6th) A10 Fusion |

758 | 1406 | 2786 |

Android 端末との比較

| 端末 | Single | Multi |

|---|---|---|

| A13 Bionic ? | 1328 | 3217 |

| iPhone XS A12 Bionic |

1107 | 2681 |

| OnePlus 7 Pro Snapdragon 855 |

722 | 2632 |

| Samsung Galaxy Note10 Snapdragon 855 |

749 | 2535 |

| iPhone X Apple A11 Bionic |

917 | 2351 |

| Huawei Mate 20 Pro Kirin 980 |

671 | 2267 |

| Sony Xperia XZ2 Snapdragon 845 |

498 | 2048 |

| Google Pixel 3 XL Snapdragon 845 |

490 | 1987 |

まとめ

Apple A13 は大体、第2世代目の iPad Pro と同じぐらいのスペックになると予想される。

現状、スマートフォンの同コア、プロセスルールの SoC のスペックでは最速となっている。

(トランジスタの数が多い Kirin 990 5G やコアの多い Snapdragon 855 Plus の方がマルチコアのスコアが高いらしい)